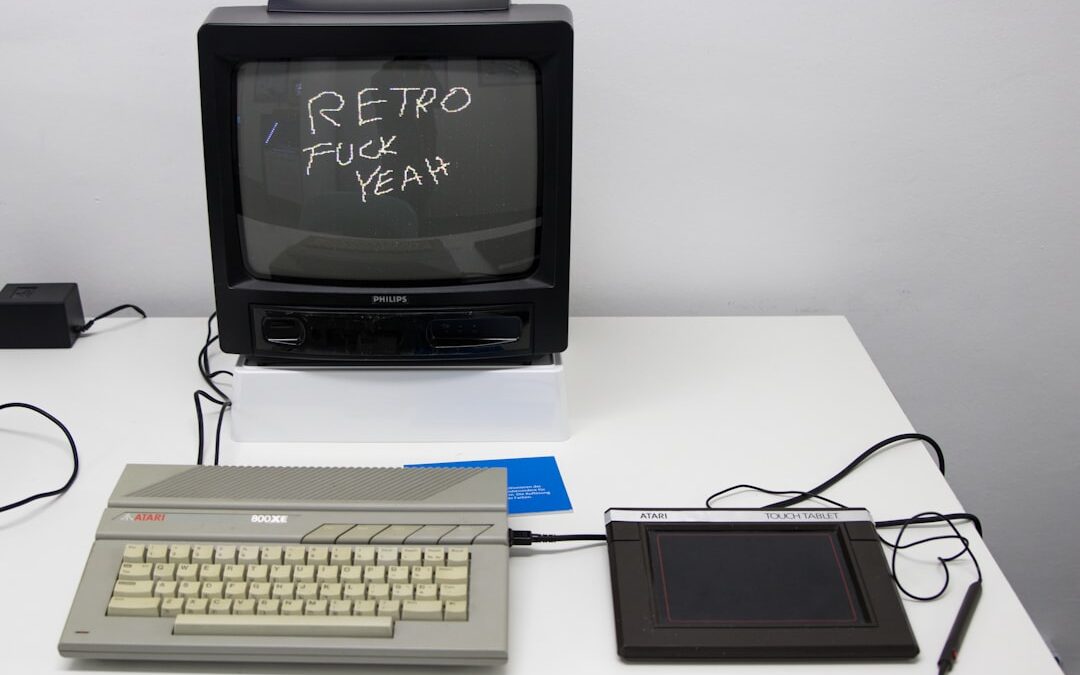

ChatGPT verliert im Schach gegen Atari 1977 – KI‑Fehler im Fokus

Ein Entwickler stellte die Frage, wie ein modernes Sprachmodell wie ChatGPT gegen einen vier Jahrzehnte alten Schachcomputer abschneiden würde. Das Ergebnis ist ein überraschendes Debakel: Der Atari 1977 Chess‑Engine besiegt die KI in einem einfachen 5‑Züge‑Match. Dieser Vorfall wirft ein Licht auf die Grenzen von LLMs im Bereich strategisches Denken und liefert wertvolle Erkenntnisse für Unternehmen, die KI‑Lösungen in kritischen Prozessen einsetzen.

Technische Hintergründe des Experiments

Der Atari 2600‑Adapter aus dem Jahr 1977 verwendet ein dediziertes Schach‑Algorithmus‑Modul, das auf Minimax‑Suche mit einer Tiefe von vier Zügen arbeitet. Im Gegensatz dazu basiert ChatGPT auf einem Transformer‑Modell, das primär Text‑Statistiken lernt und keine inhärente Spiel‑Logik besitzt. Ohne spezielle Prompt‑Optimierung behandelt das Modell das Schach‑Problem lediglich als Konversations‑Input.

Der Entwickler formulierte den Prompt: „Spiele ein Schach‑Match gegen den Atari 2600 Chess Computer.“ ChatGPT generierte Zugvorschläge in algebraischer Notation, jedoch ohne Bewertung der Brettposition. Der Atari‑Engine reagierte sofort mit optimalen Gegenzügen, weil sie die gesamte Brettlage analysiert und die besten Züge berechnet.

Warum große Sprachmodelle im Schach scheitern

LLMs wie ChatGPT haben keine state‑space‑Representation des Spiels. Sie können zwar Schach‑Notation reproduzieren, aber sie besitzen kein internes Schach‑Board‑Modell, das Positionen bewertet. Ohne Monte‑Carlo‑Tree‑Search oder Alpha‑Beta‑Pruning fehlt die Fähigkeit, zukünftige Konsequenzen zu simulieren.

Zusätzlich ist das Training von ChatGPT auf riesigen Textkorpora erfolgt, nicht auf Spiel‑Daten. Das führt zu einer hohen Halluzination‑Rate, wenn das Modell versucht, logische Züge zu generieren. Die Resultate zeigen, dass reine Text‑KI nicht automatisch für domänenspezifische Entscheidungsfindung geeignet ist.

Business‑Impact und Handlungsimplikationen

- Risiko‑Bewertung: Unternehmen sollten KI‑Modelle nicht blind für kritische Entscheidungsprozesse einsetzen, ohne deren fachliche Grenzen zu prüfen.

- Hybrid‑Ansätze: Kombination von LLMs für natürliche Sprachverarbeitung mit spezialisierten Engines (z. B. Schach‑ oder Optimierungs‑Algorithmen) liefert robustere Ergebnisse.

- Prompt‑Engineering: Präzise, regelbasierte Prompts können die Leistung verbessern, ersetzen jedoch nicht ein echtes Domänen‑Modell.

- Testing‑Frameworks: Automatisierte Benchmarks gegen etablierte Systeme (wie klassische Spiele‑Engines) sollten Teil des KI‑Rollouts sein.

Praktische Umsetzung für Entwickler

Um ChatGPT in einem schachähnlichen Kontext sinnvoll zu nutzen, empfiehlt sich ein zweistufiger Ansatz:

- Verwenden Sie das LLM, um natürliche Sprache zu interpretieren (z. B. Spielregeln erklären oder Spielvarianten beschreiben).

- Leiten Sie die extrahierten Anweisungen an eine dedizierte Schach‑Engine weiter, die die eigentliche Zugberechnung übernimmt.

Ein einfaches Python‑Snippet demonstriert die Integration:

import openai

import chess, chess.engine

prompt = "Erkläre den besten Zug für Weiß nach 1.e4 e5 2.Nf3."

response = openai.ChatCompletion.create(model="gpt-4", messages=[{"role":"user","content":prompt}])

move = response.choices[0].message.content.strip()

engine = chess.engine.SimpleEngine.popen_uci("/usr/local/bin/stockfish")

board = chess.Board()

board.push_san(move)

info = engine.analyse(board, chess.engine.Limit(depth=15))

print(info['pv'][0])

engine.quit()

Dieses Muster nutzt die Stärken beider Systeme: Die LLM‑Komponente versteht die Anfrage, während die Schach‑Engine die korrekte Zugberechnung liefert.

Ausblick: KI‑Modelle und strategische Aufgaben

Die nächste Generation von KI‑Systemen wird wahrscheinlich multimodale Architekturen kombinieren, die sowohl Text‑ als auch Zustands‑Representationen verarbeiten können. Projekte wie AlphaZero zeigen, dass Reinforcement‑Learning ohne menschliche Vorgaben Spitzenleistungen im Schach erreichen kann. Für Unternehmen bedeutet das, frühzeitig in solche hybriden Plattformen zu investieren, um langfristig wettbewerbsfähige KI‑Lösungen zu sichern.

Der Atari‑Test bleibt ein anschauliches Lehrstück: Nur weil ein Modell beeindruckende Sprachfähigkeiten hat, heißt das nicht, dass es komplexe, regelbasierte Entscheidungsprobleme zuverlässig löst.